Судя по активности участников рынка ИИ, они сейчас сосредоточены на том, чтобы наращивать вычислительные мощности, рассчитывая, что на определённом этапе количество перейдёт в качество. Один из основателей OpenAI Илья Суцкевер убеждён, что эпоха масштабирования заканчивается, и для качественного прогресса в развитии ИИ потребуются серьёзные и глубокие исследования.

Обзор смартфона HUAWEI Pura 80: удобный флагман с «Алисой»

Hollow Knight: Silksong — песнь страданий и радостей. Рецензия

Смартфон HUAWEI Mate 70 Pro как выбор фотографа

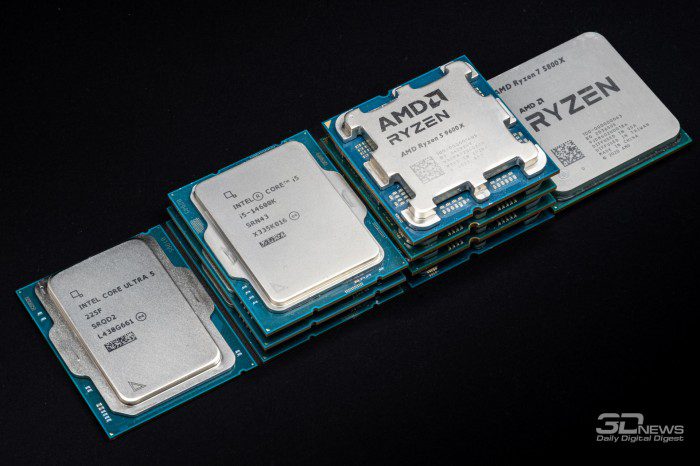

Лучший процессор за 20 тысяч рублей — сравнение и тесты

Обзор смартфона HONOR X9c Smart: прочность со скидкой

Обзор планшета HONOR Pad V9: нейросети спешат на помощь

Пять главных фишек камеры HONOR Magic 7 Pro

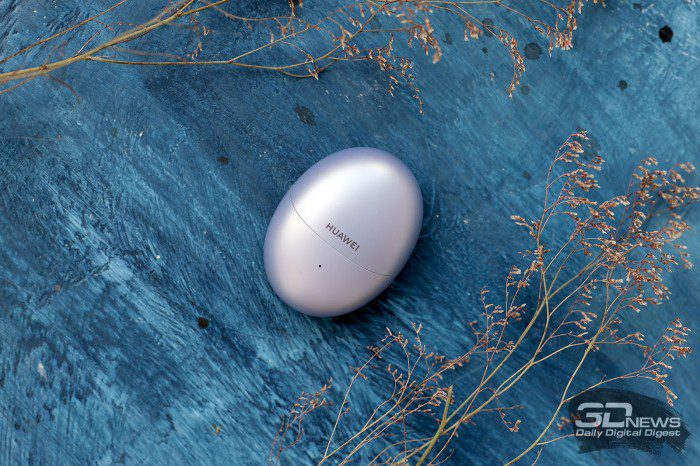

Наушники HUAWEI FreeBuds 6, которые понимают жесты

Репортаж со стенда HONOR на выставке MWC 2025: передовые новинки и стратегические планы на будущее с ИИ

Источник изображения: University of Toronto Entrepreneurship

В OpenAI Илья как раз отвечал за исследования, и уйти из этого стартапа его заставил не только конфликт вокруг несостоявшейся отставки генерального директора Сэма Альтмана (Sam Altman), но и несогласие со стратегией развития компании. Как стало понятно из недавнего интервью Ильи Суцкевера, его настораживает сохраняющаяся ориентация отрасли ИИ на экстенсивный путь развития. Большие языковые модели до сих пор совершенствовались благодаря привлечению большего количества данных, вычислительных ресурсов или увеличению количества параметров внутри самой модели.

Для участников рынка такой подход был удобен, поскольку обеспечивал понятный результат при минимальных рисках и неопределённости. Большое количество квалифицированных и талантливых исследователей при этом не требовалось, поскольку прогресс достигался увеличением количества используемых ресурсов. По мнению Суцкевера, такой путь развития скоро себя исчерпает. Во многом это произойдёт из-за истощения запаса данных, которые пригодны для обучения языковых моделей. Вся информация, доступная в интернете, уже использована для обучения ИИ.

Как убеждён Суцкевер, даже дальнейшее увеличение масштаба имеющейся инфраструктуры в сто раз не обеспечит качественного прорыва в развитии ИИ. Да, в чём-то будут заметны изменения к лучшему, но так называемый «сильный искусственный интеллект» (AGI) таким способом создан не будет. По мнению основателя Safe Superintelligence, человечество будет вынуждено вернуться в эпоху исследований, получив мощные новые инструменты, помогающие учёным в работе. Его стартап как раз занимается подобными исследованиями, как становится ясно из интервью.

Попутно Суцкевер делает важное пояснение. По его мнению, большие языковые модели обобщают знания гораздо хуже людей. Например, если молодого исследователя старший коллега обучает на примере своих работ, делая какие-то пояснения и совместно обсуждая идеи, то для обучения модели требуется создать точный план, где на каждом этапе будет проверяться достижение строго формализованных результатов, а для обучения будут использоваться огромные массивы данных с примерами. И даже в этом случае человек продемонстрирует более высокие результаты обучения, чем ИИ. Как сократить эту разницу, научное сообщество пока не знает.

Источник: 3Dnews.ru